Google no quiere que te enganches demasiado a Gemini, y tienen una idea para lograrlo

La función aparece en versiones beta de la app de Google y sugiere pausas tras sesiones largas con el chatbot, sin confirmar aún su llegada al público general

Google sabe que los seres humanos tendemos a engancharnos a cosas a las que no deberíamos, lo que incluye también los modelos de lenguaje de IA e, inevitablemente, a Gemini. Es por eso que están probando un aviso para que el usuario se tome un descanso tras un uso prolongado del chatbot, una señal de que la Gran G está virando en lo que al consumo de IA se refiere y reorientando cómo los usuarios se relacionan con ella.

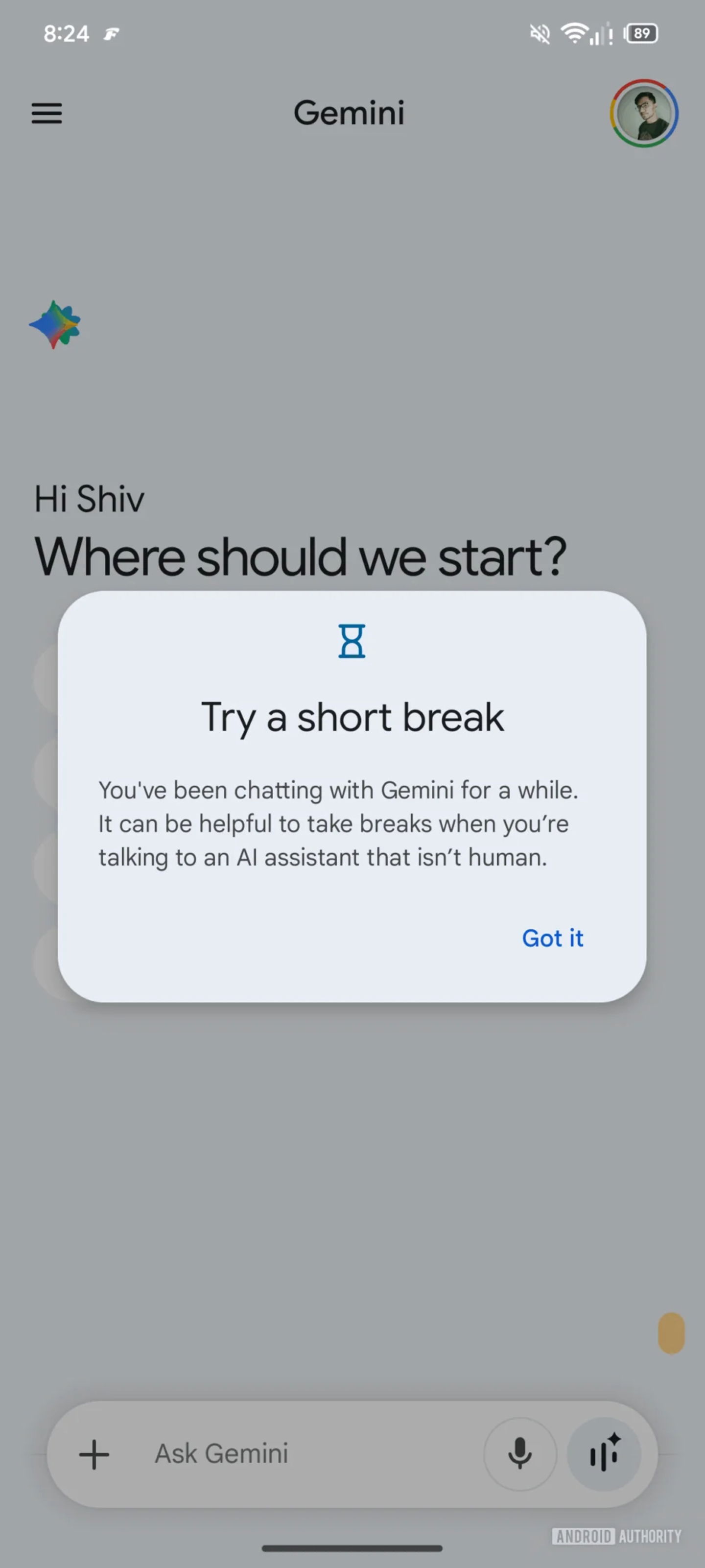

El mensaje se ha identificado en la versión beta 17.3.59 de la aplicación de Google, según han encontrado los compañeros de Android Authority en uno de sus ya famosos análisis de código. Aparece como una notificación emergente con el texto “Take a short break” y un recordatorio adicional: el usuario está interactuando con una inteligencia artificial que no es humana. Por lo que parece, se trata de un guiño para aterrizar al usuario en sesiones largas de conversación.

Un aviso simple que dice mucho sobre el rumbo de Gemini

Este es el mensaje que Google está probando en Gemini

Por ahora, no se conoce el criterio exacto que activa el mensaje. Google no ha especificado si se basa en tiempo de uso, número de interacciones o contexto de la conversación, ni si el recordatorio podrá configurarse o desactivarse en el futuro. Tampoco hay confirmación oficial de que la función vaya a desplegarse más allá de esta fase de pruebas.

El enfoque recuerda a los recordatorios de descanso que Google utiliza en YouTube desde 2021, donde el usuario puede recibir avisos tras cierto tiempo de reproducción continuada. Sin embargo, en el caso de Gemini el matiz es distinto: el mensaje no solo sugiere parar, sino que refuerza explícitamente la idea de que el interlocutor no es una persona real.

En los últimos meses, Gemini ha ido ampliando su alcance dentro del ecosistema Android, integrándose con más servicios, aplicaciones y datos del usuario. A medida que el asistente gana contexto y continuidad, también aumenta el riesgo de que algunos usuarios establezcan una relación más personal o emocional con la herramienta, algo que Google parece querer prevenir de forma activa.

Esta decisión de Google se enmarca dentro de un debate cada vez más presente en el sector y del que ya hemos visto caer presa a OpenAI: hasta qué punto los modelos de lenguaje conversacionales pueden fomentar patrones de uso problemáticos, especialmente entre personas jóvenes o en contextos de problemas de salud mental vulnerabilidad emocional. La Gran G no señala estos riesgos explícitamente, pero que te recuerden que Gemini no es humano parece ser una forma de curarse en salud ante futuros desastres.

Conviene subrayar que, a día de hoy, no hay indicios de que Gemini vaya a limitar conversaciones ni a imponer pausas obligatorias. Todo apunta a una intervención ligera, pensada más para marcar límites simbólicos que para controlar el uso de la IA. Aun así, el simple hecho de que Google experimente con este tipo de mensajes revela un cambio de tono respecto a la etapa inicial, donde el foco estaba casi exclusivamente en aumentar capacidades y tiempo de interacción.