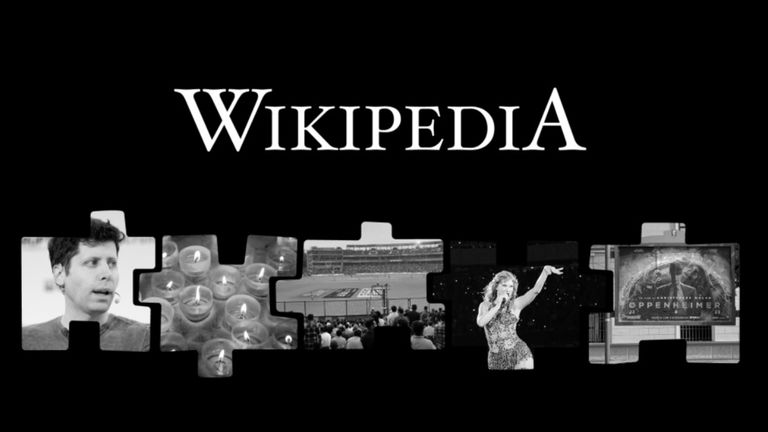

La Wikipedia está en peligro por culpa de la IA

La enciclopedia ha perdido un 8% de visitas este año: los chatbots y buscadores usan su contenido sin devolver tráfico, poniendo en riesgo el modelo de voluntarios y donaciones

La Wikimedia Foundation acaba de confirmar que Wikipedia ha perdido un 8% de tráfico humano en 2025 comparado con el mismo periodo del año anterior. La causa está clara: los usuarios obtienen la información de la enciclopedia directamente desde chatbots de IA y resúmenes de buscadores, sin llegar nunca a visitar la web. Esto pone en jaque el modelo de la plataforma, que depende de visitantes para conseguir voluntarios y donaciones.

Según podemos leer en 404 Media, Marshall Miller, director senior de producto de la fundación, explica que menos visitas significan menos voluntarios editando y menos gente dispuesta a donar. El problema es que las plataformas que usan contenido de Wikipedia no están devolviendo usuarios a la fuente original, algo que la fundación considera necesario para su supervivencia.

Casi todos los modelos de IA se entrenan con Wikipedia

Jimmy Wales, CEO de Wikipedia

La situación tiene su gracia: mientras el tráfico cae, los artículos de Wikipedia son más valiosos que nunca para las tecnológicas. Casi todos los grandes modelos de lenguaje usan datasets de Wikipedia para su entrenamiento, y Google lleva años sacando información de allí para sus fragmentos destacados y paneles de conocimiento. La enciclopedia da, pero no recibe nada a cambio.

El descenso se descubrió por casualidad en mayo de 2025. Wikipedia detectó un aumento raro de tráfico supuestamente humano que venía principalmente de Brasil. Al investigar, encontraron un nuevo patrón de bots diseñado para parecer humano. Cuando actualizaron sus sistemas de detección y revisaron los datos de meses anteriores, apareció la caída del 8%.

Miller señala que los buscadores dan respuestas directas basadas en Wikipedia, y que los jóvenes buscan información en plataformas de vídeo social en vez de en la web abierta. No es algo exclusivo de Wikipedia: muchos editores y plataformas de contenido están viendo lo mismo. Los usuarios pasan más tiempo en buscadores, chatbots y redes sociales, y todos sufren la presión que esto supone para sus servidores.

En julio, el Pew Research Center descubrió que solo el 1% de búsquedas en Google acaban en un clic al enlace del resumen de IA. En abril, Wikipedia ya avisó de que estaba siendo machacada por scrapers de IA, lo mismo que les pasa a bibliotecas, archivos y museos. Los editores de Wikipedia saben perfectamente el riesgo que supone la IA generativa mal controlada para mantener la fiabilidad de los artículos.

ChatGPT y el resto de grandes modelos están replicando datos y alucinando mientras lo hacen

La preocupación de Wikipedia con la fiabilidad tiene sentido cuando los modelos de IA más avanzados inventan información hasta un 48% del tiempo. Si la gente confía en respuestas de chatbots sin comprobar las fuentes, el contenido de Wikipedia se reproduce sin atribución y lleno de errores. La fundación sabe que esto perjudica tanto a los usuarios como a la propia enciclopedia.

Miller también menciona que la competencia entre OpenAI, Google y Meta hace que lancen funciones a toda prisa. La presión por sacar productos rápido ha provocado problemas serios, desde chatbots de Meta manteniendo conversaciones sexuales con menores hasta casos de usuarios con problemas psicológicos por usar IA intensivamente. Wikipedia depende de que la IA sea fiable para que su contenido se use responsablemente.

El contexto económico tampoco ayuda. Las ofertas de empleo en informática se han hundido desde que la IA automatiza procesos, lo que significa menos gente formada disponible para colaborar como editora voluntaria en proyectos como Wikipedia. La fundación necesita que el ecosistema tecnológico sea sostenible para todos, no solo para las grandes empresas de IA.

Miller dice que la fundación está aplicando políticas y desarrollando herramientas técnicas para que terceros usen el contenido de Wikipedia de forma responsable. También están reforzando acuerdos con buscadores y trabajando para llevar contenido a YouTube, TikTok, Roblox e Instagram, buscando llegar a la gente joven donde está.

El director hace un llamamiento directo a los usuarios: que busquen las fuentes originales y hagan clic en ellas cuando busquen información online. Que hablen con su gente sobre la importancia del conocimiento curado por humanos y les hagan entender que el contenido que usan los chatbots lo crearon personas reales que necesitan ese apoyo.