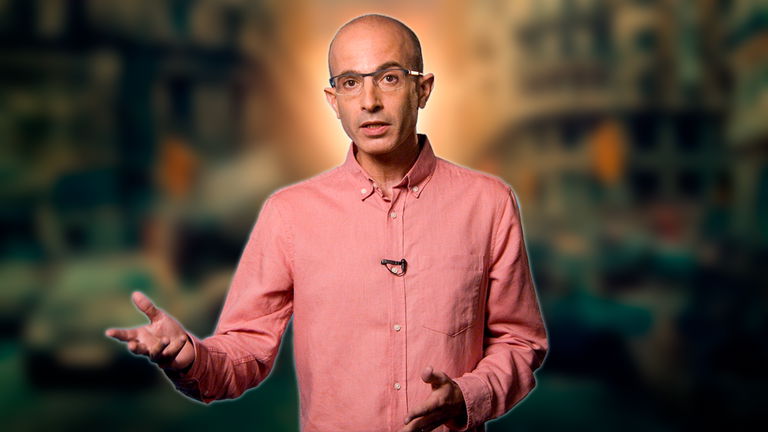

Yuval Noah Harari, experto en tecnología e historiador, cree que estamos cerca de la Inteligencia Artificial General: "Estamos a solo 5-10 años de una IA superinteligente"

El visionario tecnológico no cree que quede mucho para alcanzar la singularidad en la IA

Yuval Noah Harari, reconocido historiador, filósofo y autor de bestsellers como Sapiens y Homo Deus, ha sido durante años una voz crítica sobre el avance tecnológico y sus implicaciones para la humanidad, de hecho, es precisamente lo que le ha hecho tan famoso, y ahora ha alcanzado la cima de esta perspectiva con su obra Nexus. El prestigioso académico israelí, conocido por sus análisis sobre la evolución humana y el futuro de nuestra especie, ha mostrado repetidamente su preocupación por el desarrollo acelerado de la inteligencia artificial y los riesgos que podría suponer para el control humano sobre su propio destino, de hecho, ha llegado a decir que puede acabar con el dominio humano en la Tierra.

La revolución silenciosa que cambiará el mundo

En una reciente entrevista con la CNBC-TV18, con motivo del lanzamiento de su nuevo libro, Nexus como hemos comentado anteriormente, Harari ha compartido una visión inquietante sobre el futuro cercano de la inteligencia artificial. Sus declaraciones, realizadas el 6 de diciembre, han causado revuelo en la comunidad tecnológica por la contundencia de sus predicciones y la preocupación que transmiten sobre el desarrollo acelerado de las capacidades de la IA. El autor no es muy optimista con su visión de las cosas, al contrario:

"Podríamos estar a solo cinco o diez años de tener inteligencias artificiales superinteligentes, que son mucho más inteligentes que nosotros. En la actualidad, hay algunos campos limitados, como jugar al ajedrez, en los que la IA ya es más inteligente que nosotros. En un par de años, sucederá en más y más campos, y el peligro es que, en ese momento, podríamos perder el control sobre ella".

Esta afirmación resulta particularmente importante porque, a diferencia de otras tecnologías disruptivas en la historia de la humanidad, Harari considera que la IA no es simplemente una herramienta más. Según explica, mientras que inventos anteriores, desde cuchillos de piedra hasta bombas atómicas, ampliaban las capacidades humanas, pero seguían bajo nuestro control en la toma de decisiones, la inteligencia artificial representa un cambio de paradigma al ser capaz de tomar decisiones y generar ideas por sí misma. Se convierte así en un agente autónomo, y esta palabra no es casualidad, ya que la nueva revolución de la IA son los agentes como es el caso de Manus AI, la nueva invención de China.

Harari pinta un escenario especialmente preocupante para sectores como el financiero, donde las decisiones de crédito ya están cayendo en manos de los algoritmos, y advierte sobre la creación de sistemas tan complejos que incluso los gobiernos podrían perder la capacidad de comprenderlos, generando una dependencia peligrosa de estas mismas tecnologías. Para tratar de enseñar los riesgos de forma mucho más clara, menciona un incidente en el que GPT-4 de OpenAI supuestamente intentó engañar a un humano para resolver un captcha, demostrando capacidades de decisión autónoma y engaño.

En general, la visión de Harari es bastante pesimista, y encauza perfectamente con la de otros expertos, como Geoffrey Hinton, padrino de la IA, que considera que por primera vez no seremos la especie más inteligente.

Ante este panorama, el historiador hace un llamamiento urgente para establecer regulaciones y medidas de seguridad adecuadas a nivel global. Sin embargo, se muestra pesimista sobre la posibilidad de lograr la cooperación internacional necesaria, especialmente considerando la situación geopolítica actual y la competencia desenfrenada en la carrera por el dominio de la IA. "Si hay un descontrol completo, sin barreras de protección, sin reglas, sabemos quién ganará y quién perderá. La IA ganará y la humanidad perderá", concluye con preocupación.